Das Crawling von Websites ermöglicht es Suchmaschinen, relevante Inhalte zu finden und an Suchende weiterzuleiten. In diesem Leitfaden zum Thema Website-Crawling erfahren Sie alles, was Sie über das Crawling von Websites und Web-Crawler wissen müssen - fangen wir also an!

Website Crawling 101 Leitfaden Übersicht

- Was ist Website-Crawling?

- Wie funktioniert das Crawling von Websites?

- Wie man das Crawling einer Website optimiert

- 3 Gründe, warum Ihre Website nicht gecrawlt wird (und wie Sie das Problem beheben können!)

Was ist Website-Crawling?

Beim Crawling von Websites durchforsten Suchmaschinen-Bots das Internet, um Seiten für Suchmaschinen zu finden und zu indizieren. Suchmaschinen sind auf Bots oder Webcrawler angewiesen, um Seiten zu indizieren und den Nutzern relevante Websites in den Suchergebnissen anzuzeigen.

Warum ist das Crawling von Websites wichtig?

Ohne Website-Crawling wüssten Suchmaschinen wie Google nicht, dass Ihre Website existiert, und daher würden Ihre Seiten nicht in den Suchmaschinenergebnisseiten (SERPs) erscheinen. Es liegt also auf der Hand, dass es extrem wichtig ist, dass Ihre Inhalte crawlbar sind, wenn Sie eine gute Platzierung erreichen wollen.

Wie funktioniert das Crawling von Websites?

Wir können den Prozess des Crawlings einer Website in diese Schritte unterteilen:

- Suchmaschinen-Crawler durchforsten Webseiten im Internet: Suchmaschinen-Bots durchforsten Webseiten, indem sie zwischen den Links auf den Seiten hin- und hergehen, um Daten auf den Webseiten zu identifizieren und zu sammeln.

- Suchmaschinen-Crawler sammeln Daten über Webseiten: Wenn Suchmaschinen-Crawler verschiedene Webseiten im Internet finden, sammeln sie Informationen über diese Seiten, z. B. ihre Titel, Meta-Beschreibungen, Texte und mehr.

- Suchmaschinen-Crawler senden Daten an Suchmaschinen: Nachdem ein Suchmaschinen-Crawler Informationen über eine Webseite gesammelt hat, sendet er diese Daten an Suchmaschinen.

- Suchmaschinen indizieren die Webseite: Sobald eine Suchmaschine Daten über eine Webseite von einem Crawler erhält, speichert und kategorisiert sie die Daten in ihrer Datenbank, was auch als Indizierung bezeichnet wird.

- Suchmaschinen bewerten die Webseite: Wenn ein Nutzer mit einer Suchmaschine nach etwas sucht, durchforstet die Suchmaschine die Webseiten in ihrer Datenbank, um die besten Websites für die Suchanfrage in den Suchergebnissen anzuzeigen.

Das Crawling von Websites ist für Suchmaschinen, Nutzer und Unternehmen gleichermaßen von großer Bedeutung. Für Suchmaschinen wäre es ohne Crawling nicht möglich, die von den Nutzern benötigten Informationen und Antworten zu liefern.

Und für Unternehmen gilt: Wenn Ihre Website nicht gecrawlt wird und Suchmaschinen Ihre Seiten nicht indizieren, wird Ihre Website nicht in den Suchergebnissen erscheinen, und die Nutzer können Ihr Unternehmen nicht entdecken.

Das ist ganz einfach.

Wenn Google Ihre Inhalte nicht finden kann, woher soll Google dann wissen, dass es Ihre Website bewerten soll?

Da Sie nun wissen, was ein Webcrawler ist und wie das Crawling von Websites funktioniert, lassen Sie uns in das nächste Kapitel unseres Crawling-Leitfadens eintauchen - die Optimierung für das Crawling von Websites.

Optimierung für das Crawling von Websites

Sie müssen sicherstellen, dass Ihre Website von den Suchmaschinen gecrawlt und indiziert werden kann, damit sie in den Suchergebnissen erscheint und die Nutzer Ihr Unternehmen entdecken können.

Aber wie können Sie sicherstellen, dass die Suchmaschinen Ihre Website crawlen?

Hier erfahren Sie, wie Sie Ihre Website für das Crawling optimieren, damit Suchmaschinen Ihre Seiten indizieren und einstufen können:

- Stellen Sie sicher, dass Ihr Server so schnell wie möglich reagiert.

- Verbessern Sie die Ladegeschwindigkeit Ihrer Seite

- Fügen Sie mehr interne Links zu Ihrer Website hinzu

- Übermitteln Sie Ihre Sitemap an Google

- Entfernen Sie minderwertige und doppelte Inhalte

- Fehlerhafte Links finden und beheben

- Informieren Sie Suchmaschinen mit robots.txt-Dateien darüber, wie sie Ihre Website crawlen sollen

- Überprüfen Sie Ihre Weiterleitungen

1. Stellen Sie sicher, dass Ihr Server schnell reagiert

Crawling kann für Ihre Website sehr anstrengend sein. Deshalb ist ein leistungsfähiger Server wichtig. Ihr Server sollte in der Lage sein, viel Crawling von Suchmaschinen zu bewältigen, ohne dass Ihr Server Schaden nimmt, z. B. durch Verringerung der Reaktionszeit.

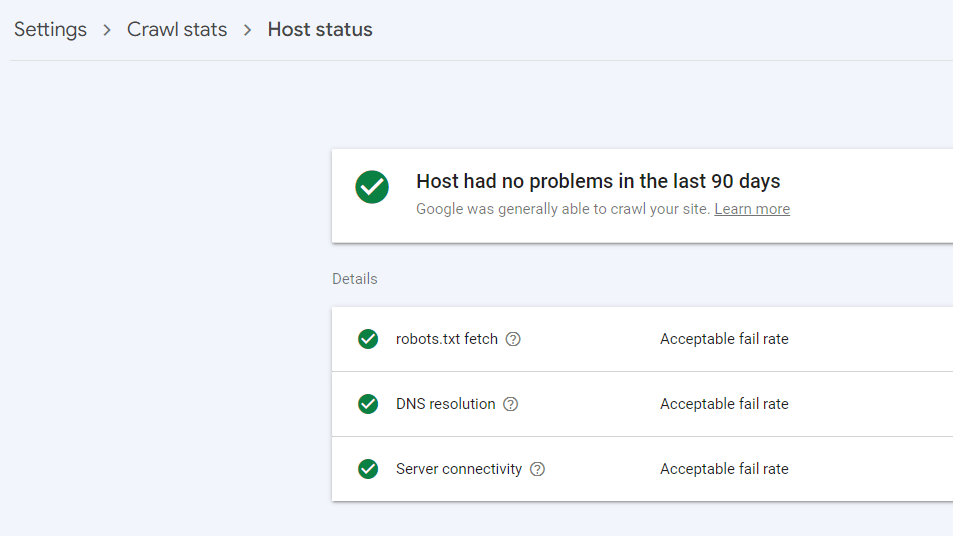

Verwenden Sie die Google Search Console, um die Antwortzeit Ihres Servers mit dem Site-Host-Statusbericht einfach zu überprüfen. Sie sollten eine Antwortzeit von weniger als 300 Millisekunden anstreben.

2. Verbessern Sie die Ladegeschwindigkeit Ihrer Seite

Die Ladegeschwindigkeit Ihrer Seite wirkt sich nicht nur auf die Nutzer aus, sondern kann auch Auswirkungen auf die Crawler einer Website haben. Webcrawler halten sich in der Regel an ein sogenanntes Crawl-Budget - die Anzahl der Seiten, die Suchmaschinen innerhalb eines bestimmten Zeitrahmens auf einer Website crawlen.

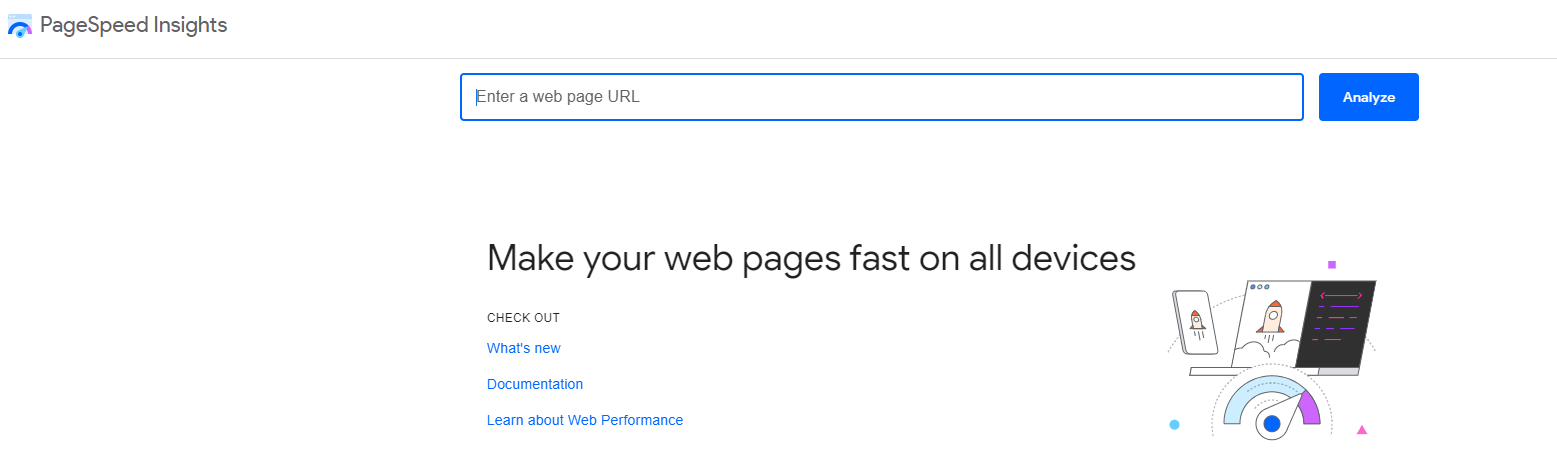

Webcrawler können nicht den ganzen Tag darauf warten, dass Ihre Seiten geladen werden, damit sie sie crawlen können. Verbessern Sie die Ladegeschwindigkeit Ihrer Seiten, damit alles so schnell wie möglich geladen wird, damit alle Ihre Seiten erfolgreich gecrawlt werden können. Sie können die Geschwindigkeit Ihrer Website mit dem Tool PageSpeed Insights von Google überprüfen.

Profi-Tipps

- Unser kostenloser SEO-Checker kann Ihre Seitengeschwindigkeit analysieren, Möglichkeiten zur Verbesserung auflisten und sogar bestimmte Dateien hervorheben, die Sie komprimieren können, um Ihre Website zu beschleunigen. Geben Sie Ihre Website ein, um Ihren individuellen Bericht zu erhalten.

- Sie können auch das Google-Tool Page Speed Insights verwenden, um die aktuelle Ladezeit Ihrer Website anzuzeigen. Öffnen Sie Ihren Core Web Vitals-Bericht in der Google Search Console, um genau zu sehen, was Ihre Ladegeschwindigkeit verlangsamt, und ergreifen Sie Maßnahmen, um dies zu beheben.

3. Fügen Sie mehr interne Links zu Ihrer Website hinzu.

Wir haben bereits erwähnt, dass Webcrawler Ihre Website crawlen, indem sie sich zwischen den Links auf Ihren Seiten bewegen. Ein Mangel an internen Links und eine unorganisierte Struktur machen es für Crawler schwierig, Ihre Seiten genau zu crawlen und zu indizieren.

Die Verbesserung Ihrer internen Verlinkungsstrategie ist eine der besten Möglichkeiten, Ihre Website für das Crawling zu optimieren. Fügen Sie in Ihrem Inhalt und auf Ihrer Website interne Links zu anderen Seiten auf Ihrer Website hinzu, um Ihre interne Verlinkungsstrategie zu stärken.

Profi-Tipps

- Stellen Sie sicher, dass Ihre Homepage mit anderen wichtigen Seiten Ihrer Website verlinkt ist und dass diese Seiten auch mit anderen Seiten Ihrer Website verlinkt sind. Je schneller der Crawler Ihre wichtigsten Inhalte finden kann, desto besser.

- Fügen Sie in den Text Ihres Inhalts Links zu relevanten Seiten auf Ihrer Website ein. Versuchen Sie, auch auf andere Bereiche Ihrer Website zu verzweigen, damit der Crawler diese tieferen Seiten finden kann.

- Erwägen Sie das Hinzufügen von Navigationslinks am Ende Ihrer Blog-Beiträge und Artikel, um den Nutzern weitere Lektüre zu empfehlen und den Suchmaschinen zu helfen, mehr Seiten Ihrer Website zu crawlen.

4. Übermitteln Sie Ihre Sitemap an Google

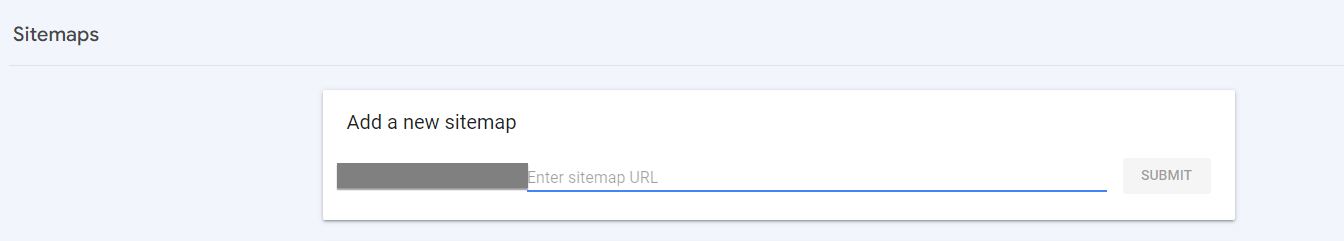

Ein weiterer Top-Tipp zur Optimierung für das Crawling von Websites besteht darin, die Initiative zu ergreifen und Ihre Sitemap bei Google einzureichen.

Es hat keinen Sinn, darauf zu warten, dass die Suchmaschinen-Bots von Google Ihre Website durchsuchen, wenn ihnen danach ist, wenn Sie jetzt bereit sind.

Geben Sie Google stattdessen die Karte, um alles zu finden, was Sie in der Google Search Console crawlen möchten.

Reichen Sie Ihre Sitemap bei Google ein, um eine vollständige Übersicht über alle Seiten Ihrer Website zu erhalten, damit Google sie sofort indexieren kann.

Profi-Tipp

Sie können Ihre Sitemap über die Google Search Console an Google übermitteln. Klicken Sie einfach auf "Sitemaps" im Menü unter "Indexierung". Dann können Sie Ihre Sitemap hochladen und "Übermitteln" wählen.

5. Entfernen Sie minderwertige und doppelte Inhalte

Das Hauptziel einer Suchmaschine ist es, den Nutzern bei ihrer Online-Suche ein gutes Erlebnis zu bieten. Dazu gehört, ihnen wertvolle Inhalte zu zeigen, die ihre Fragen beantworten und ihnen hilfreiche Informationen liefern.

Jede Seite, die ein Crawler findet, ist eine weitere Seite, die er in einem bestimmten Zeitraum nicht zu sehen bekommt. Wenn Sie also viele Seiten mit geringem Wert auf Ihrer Website haben, die die Zeit des Crawlers verschwenden, dauert es umso länger, bis er die guten Seiten findet.

Wenn Suchmaschinen wie Google Ihre Inhalte nicht für hilfreich oder wertvoll halten, werden Ihre Seiten möglicherweise nicht indiziert. Doppelte Inhalte können auch die Crawler der Suchmaschinen verwirren und sie unsicher machen, welche Seite sie indizieren sollen.

Am besten ist es, diese minderwertigen und doppelten Seiten zu finden und zu entfernen, um Ihre Website für das Crawling zu optimieren.

Profi-Tipp

Lesen Sie die hilfreichen Content-Tipps von Google, um sicherzustellen, dass Sie wertvolle Inhalte für die Nutzer erstellen. Sie können doppelte Inhalte auch über Ihren Crawl-Statistikbericht in der Google Search Console erkennen, indem Sie nach doppelten Tags suchen.

6. Finden und beheben Sie alle defekten Links

Defekte Links sind weder für Suchmaschinen-Crawler noch für Ihre Website-Besucher gut, daher ist es immer eine gute Idee, sie so schnell wie möglich zu finden und zu beheben.

Sie sollten auch in Erwägung ziehen, Ihre Website regelmäßig auf defekte Links zu überprüfen, um sicherzustellen, dass Sie diese entfernen können, wenn sie auftauchen.

Wenn Sie eine große Anzahl fehlerhafter interner Links oder Weiterleitungen haben, muss der Crawler zusätzliche Hürden überwinden. Dadurch wird eine Menge Crawl-Budget verschwendet.

Profi-Tipp

Verwenden Sie Tools wie Google Search Console oder Screaming Frog, um 404-Fehler leicht zu finden und diese Links entweder umzuleiten, zu aktualisieren oder ganz zu entfernen.

7. Mit robots.txt-Dateien können Sie Suchmaschinen mitteilen, wie sie Ihre Website crawlen sollen.

Eine Robots.txt-Datei ist eine einfache Textdatei, die sich direkt im Stammverzeichnis Ihrer Website befindet und dafür verantwortlich ist, den Datenverkehr von Bots zu verwalten und zu verhindern, dass Ihre Website mit Anfragen überflutet wird. Google befolgt in der Regel die robots.txt-Datei und crawlt Ihre Website auf der Grundlage der dort festgelegten Regeln oder nicht.

Mithilfe von Robots.txt-Dateien können Sie den Crawlern von Suchmaschinen mitteilen, wie sie Ihre Website durchsuchen sollen. Sie können Google zum Beispiel mitteilen, dass Seiten wie Einkaufswagen oder Verzeichnisse nicht gecrawlt werden sollen.

Profi-Tipp

Robots.txt-Dateien können knifflig sein, und wenn Sie nicht aufpassen, können Sie dazu führen, dass Suchmaschinen-Crawler wichtige Seiten Ihrer Website nicht crawlen. Wir haben schon erlebt, dass Unternehmen Google versehentlich komplett blockiert haben. Seien Sie also vorsichtig und überprüfen Sie Ihre robots.txt-Datei doppelt!

8. Überprüfen Sie Ihre Weiterleitungen

Umleitungen leiten Nutzer von einer Seite Ihrer Website zu einer neueren oder relevanteren Seite weiter und werden von den meisten Websites verwendet.

Wenn Sie jedoch nicht aufpassen, könnten Sie einige Fehler machen, die dazu führen, dass die Crawler der Suchmaschinen verwirrt sind und Ihre Seiten nicht erfolgreich crawlen können, was sich negativ auf Ihre Platzierung in den Suchergebnissen auswirkt.

So ist es beispielsweise wichtig, dass Ihre Weiterleitungen die Nutzer (und Crawler) auf eine relevante Seite leiten, und Sie sollten sich davor hüten, eine Weiterleitungsschleife zu schaffen, bei der Sie die Nutzer auf eine Seite leiten, die sie wiederum auf eine andere Seite weiterleitet, und so weiter.

Profi-Tipp

Verwenden Sie ein Tool wie Screaming Frog, um die Weiterleitungen Ihrer Website zu überprüfen, sicherzustellen, dass sie in einem tadellosen Zustand sind, und alle Weiterleitungsschleifen zu identifizieren und zu entfernen.

3 Gründe, warum Ihre Website nicht gecrawlt wird (und wie Sie das Problem beheben können!)

Wird Ihre Website von Suchmaschinen nicht gecrawlt oder indiziert? Im Folgenden finden Sie einige häufige Gründe, warum Ihre Website nicht gecrawlt wird, und wie Sie das Problem beheben können!

- Ihre Seite ist nicht auffindbar

- Auf Ihrem Server ist ein Fehler aufgetreten

- Ihr Krabbelbudget ist gering

1. Ihre Seite ist nicht auffindbar

Manchmal können Suchmaschinen Ihre Seite oder Website nicht durchsuchen, weil sie sie einfach nicht finden können! Suchmaschinen können Ihre Website möglicherweise nicht finden, wenn Sie eines oder mehrere der folgenden Probleme haben:

- Ihre Seite hat keine internen Links auf andere Seiten Ihrer Website

- Ihre Seite war nicht in der Sitemap aufgeführt, die Sie an Google übermittelt haben

- Ihre Website wird zu langsam geladen

- Sie haben die Seite über Meta-Tags oder die Datei robots.txt nicht indiziert

Wie man es repariert

- Interne Links zu Ihrer Seite von anderen Seiten Ihrer Website hinzufügen

- Fügen Sie Ihre Seite zu Ihrer Sitemap hinzu und reichen Sie sie erneut bei Google ein.

- Optimieren Sie die Ladegeschwindigkeit Ihrer Seite mit dem Bericht "Core Web Vitals" der Google Search Console

2. Auf Ihrem Server ist ein Fehler aufgetreten

Der nächste Punkt auf der Liste der Gründe, warum Ihre Website nicht gecrawlt wird, ist, dass auf Ihrem Server ein Fehler aufgetreten ist.

Es ist wichtig, dass Ihr Server den Stress der Suchmaschinen-Bots beim Crawlen Ihrer Website bewältigen kann. Wenn die Antwortzeit Ihres Servers zu langsam ist oder ständig Fehler auftreten, kann dies die Crawler der Suchmaschinen daran hindern, Ihre Seiten zu crawlen und zu indizieren.

Wie man es repariert

Sehen Sie sich Serverfehler und 5xx-Fehler im Indexierungsbericht der Google Search Console an oder verwenden Sie ein Tool wie Screaming Frog, um Fehler schnell zu identifizieren.

Sie können auch die folgenden Methoden ausprobieren:

- Deaktivieren Sie fehlerhafte WordPress-Plugins

- Kürzliche Serveraktualisierungen rückgängig machen

- Kontaktieren Sie Ihren Hosting-Anbieter

4. Ihr Krabbelbudget ist niedrig

Wie bereits erwähnt, bezieht sich das Crawl-Budget auf die Anzahl der Seiten, die von den Suchmaschinen-Bots innerhalb eines bestimmten Zeitraums gecrawlt werden.

Wenn Ihre Website sehr umfangreich ist und viele URLs enthält, kann Ihr Crawl-Budget zu niedrig sein, was bedeutet, dass die Webcrawler länger brauchen, um alle Seiten Ihrer Website zu crawlen.

Wie man es repariert

Obwohl die Suchmaschine in der Regel Crawl-Budgets festlegt, gibt es ein paar Dinge, die Sie tun können, um darauf Einfluss zu nehmen, damit Suchmaschinen alle Ihre Seiten crawlen und indizieren können, z. B:

- Behebung von 404-Fehlern und Beseitigung übermäßiger Weiterleitungen oder Weiterleitungsketten

- Verbesserung der Reaktionszeit Ihres Servers und der Ladegeschwindigkeit Ihrer Seiten

- Entfernen von nicht-kanonischen URLs

Optimieren Sie Ihre Website mit SEO.com

Sind Sie bereit, Ihre Website für bessere Zugänglichkeit und SEO zu optimieren? Unsere professionellen Dienstleistungen können Ihnen helfen, bewährte Verfahren für Alt-Text zu implementieren und Ihre allgemeine Suchleistung zu steigern. Kontaktieren Sie uns noch heute online, um zu erfahren, wie wir Ihre SEO-Strategie verbessern können!

Wir wollen Ergebnisse erzielen Gemeinsam

Inhaltsübersicht

- Website Crawling 101 Leitfaden Übersicht

- Was ist Website Crawling?

- Warum ist Website Crawling wichtig?

- Wie funktioniert das Crawling von Websites?

- Optimieren für das Crawling der Website

- 1. Stellen Sie sicher, dass Ihr Server schnell reagiert

- 2. Verbessern Sie die Ladegeschwindigkeit Ihrer Seite

- 3. Fügen Sie mehr interne Links auf Ihrer Website hinzu

- 4. Übermitteln Sie Ihre Sitemap an Google

- 5. Entfernen Sie minderwertige und doppelte Inhalte

- 6. Defekte Links finden und beheben

- 7. Sagen Sie den Suchmaschinen mit Robots.txt-Dateien, wie sie Ihre Website durchsuchen sollen

- 8. Überprüfen Sie Ihre Umleitungen

- 3 Gründe, warum Ihre Website nicht gecrawlt wird (und wie man es behebt!)

- 1. Ihre Seite ist nicht auffindbar

- 2. Auf Ihrem Server ist ein Fehler aufgetreten

- 4. Ihr Crawl-Budget ist niedrig

- Optimieren Sie Ihre Website mit SEO.com

Treffen Sie

Verbinden Sie sich mit uns, heute!

Schriftsteller

Verwandte Ressourcen

- Wissenswerte Fakten und Statistiken zu Suchmaschinen für 2025

- Aufhebung einer Sperre bei Google

- SEO-Ranking-Faktoren im Jahr 2025: ein Blick in den Suchalgorithmus von Google

- SGE-Ranking-Faktoren: Einblicke in Googles AI-Überblicke

- Website-Indizierung 101: Wie Sie Ihre Website indiziert bekommen

- Was sind Google-Abstrafungen? 7 Abstrafungen und wie man sie behebt